2023年10月30日、米国でAIに関する大統領令第14110号(「AI大統領令」)※1 が発せられた。これについては、日本のメディアでも大きく報道されたのでご存じの方も多いだろう。ここでは前後の動きも踏まえて、この大統領令の内容を見ていき、米国のAI規制の概観をお伝えしたい。

民間での使用に関しては個��別法対応

米国ではAI大統領令が発出される前も、AIに関する法律はいくつか制定されていたが、いずれもAIの研究開発に予算をつけることや、政府内にAIに関する機関を設置することを主な内容とし、民間に対して何らかの規制を設けるものではなかった(2022年に制定された米国AI促進法(Advancing American AI Act of 2022)は、政府におけるAI使用に関して、そのユースケースをインベントリ化し、公開することを求めるものであるが、民間に対する義務づけを内容とするものではなかった)。

他方、従前の大統領令においても、何らかの原則を掲げたり、政府内におけるAI使用について規制を設けたりすることはあったものの、民間におけるAI開発や使用に関する規制には言及してこなかった。

その他の政府機関からも、「AI権利章典の青写真(Blueprint for an AI Bill of Rights)」※2(米国科学技術政策局(OSTP)、2022年10月)、AIリスクマネジメントフレームワーク(AI RMF 1.0)※3(国立標準技術研究所(NIST)、2023年1月)などの白書や基準が発表されているが、いずれも法的拘束力はないと明記されている。

AI規制は党派色の強い論点

これは、米国の議会状況に由来する。すなわち米国では、民間に対するAI規制は党派色の強い論点であり(共和党は規制をすべきではないという自由放任姿勢であり、民主党は共和党と比較するとある程度規制を容認するという傾向がある)、尖鋭な党派対立を招くと思われるEUのAI Act案のような包括的なAI規制には踏み込めないでいる。対して大統領令は、行政府の長である大統領が各行政機関に対して命令をするというものであり、大統領令によって国民の義務を創出する新たな立法をするわけにはいかない(それは議会の役割である)。このような事情のもと、米国では、民間事業者に対して法的拘束力を有する包括的なAI規制を内容とする法令は作られてこなかった。

とはいえ、米国がAIについてまったく規制をしていないわけではなく、既存の個別法に基づき規制当局が動いている。例えば、食品医薬品局(FDA)による AI 医療機器規制、運輸省による自動運転車規制、消費者製品安全委員会(CPSC)による消費者製品の安全性規制、住宅都市開発省(HUD)による入居審査におけるアルゴリズムのバイアス規制などである。

そうした中、2023年7月、OpenAIやGoogleなど主要AI企業は、大統領府との間で、①生物学的リスク・サイバーセキュリティに関するアセスメントの実施、②一定のリスク等について政府との間で情報共有、③モデルの重み保護のためのセキュリティ対策の実施、④生成AIコンテンツかどうかを区別するためのコンテンツ認証・電子透かし措置の実施、⑤モデルの能力等の一般公開、などを内容とする自主ルールについて合意した。

2023��年10月、責任あるAIの開発・使用に関して、大統領令が発出

そして、2023年10月30日、前述の大統領令第14110号「AIの安全、セキュアで信頼できる開発・使用(Safe, Secure, and Trustworthy Development and Use of Artificial Intelligence)」が発出された。これは、大統領令にしては非常に長大で、責任あるAIの開発・使用に関して、政府機関のみならず、民間企業にも一定の規制を課そうとするものである。なお、ここで対象となるAIには生成AIも含まれる。

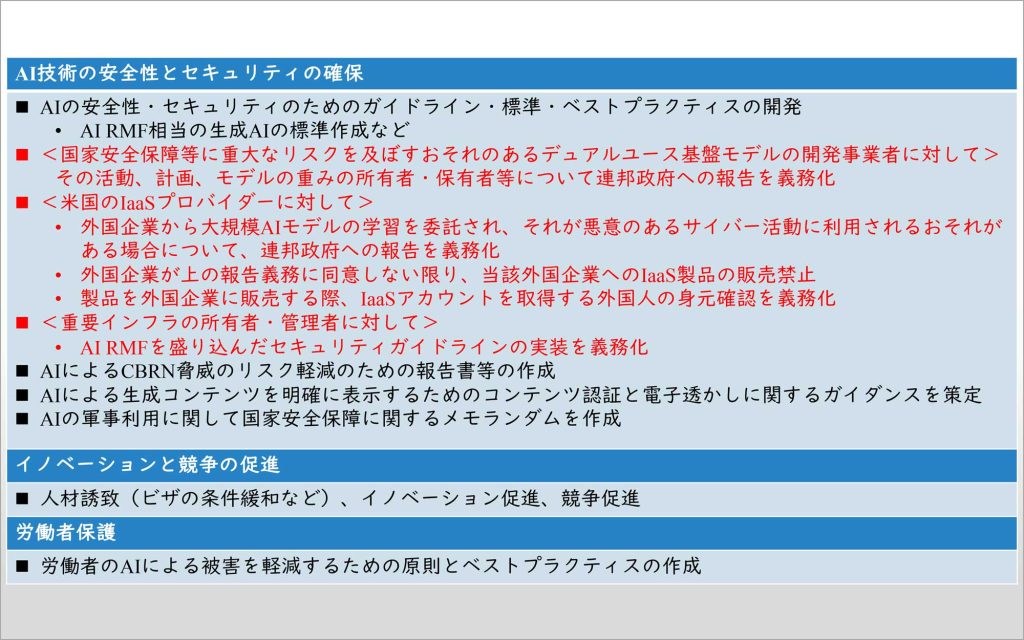

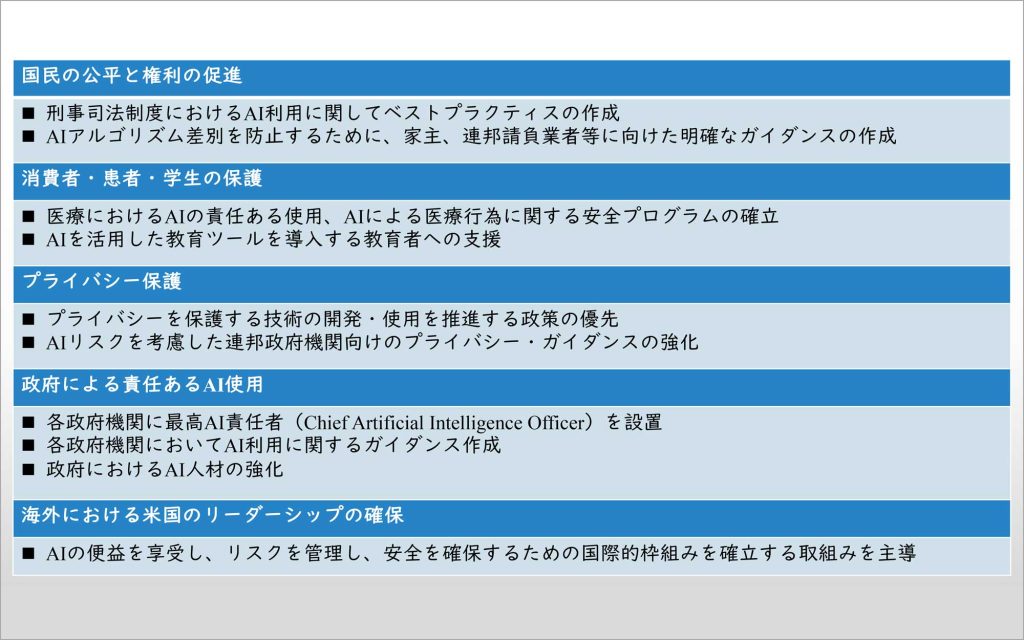

大統領令の概要は下表の通りである(赤字は、民間事業者に対する規制を示す)。

上表にある通り、規制を受ける民間事業者は、現時点で明確なのは、

1. 一定のリスクを及ぼす危険のあるデュアルユース基盤モデルの開発事業者

2. 外国企業と取引をするIaaSプロバイダー

3. 重要インフラの所有者・管理者

という比較的限定的な範囲にとどまり、その義務の内容も、報告義務や、今後作成されるセキュリティ・ガイドラインの実装といった内容にとどまる。これらの規制は既存の個別法に基づいて実施される予定である。

その他、電子透かしやAIアルゴリズム防止、刑事司法制度等に関してガイダンスやベストプラクティスが作成されることが記述されているが、それらの内容及びどの程度法的拘束力を伴って義務化されるのかについては今後のガイダンス等の作成に委ねられている。

いずれにしても、現時点では、EUのAI Act案のように、一般の民間事業者に対して広く規制を及ぼす、違反に関して制裁金を課すという内容にはなっていない。

政府が使用するAIについては、アルゴリズムによる差別の除去などが求められている

大統領令を受けて、2023年11月、行政管理予算局(OMB)から、「政府によるAI使用のガバナンス・イノ ��ベーション・リスク管理を促進する(Advancing Governance, Innovation, and Risk Management for Agency Use of Artificial Intelligence)」というメモランダム案※4 が発表された。

一般的に、OMBメモランダムは大統領令等を受けて、各行政機関に対して具体的に行うべきことを指示するものであるところ、このメモランダム案では、政府におけるAI使用のリスク管理として、「安全性に影響するAI(safety-impacting AI)」※5 と「権利に影響するAI(right-impacting AI)」※6 について、①影響アセスメントの実施・文書化、②性能テストの実施、③継続的なモニタリング、④高リスクのあ一般的に、OMBメモランダムは大統領令等を受けて、各行政機関に対して具体的に実施すべきことを指示するものであるところ、このメモランダム案では、政府におけるAI使用のリスク管理として、「安全性に影響するAI(safety-impacting AI)」※5 と「権利に影響するAI(right-impacting AI)」※6 について、①影響アセスメントの実施・文書化、②性能テストの実施、③継続的なモニタリング、④高リスクのある決定においては人の介在・透明性を確保すること、⑤アルゴリズムによる差別の除去・緩和、⑥悪影響を受ける個人への通知などの最低限のプラクティスを2023年8月までに実施するようにし、最低限のプラクティスに反するAIの使用を停止することを求める。このメモランダム案は、パブコメ期間を経て2024年3月頃に確定する予定である。

まだドラフトの段階であるとはいえ、2023年8月という期限や、求めている最低限のプラクティスの具体性を見ると、かなり踏み込んだ内容といえよう。とはいえ、あくまでも政府内でのAI使用に関する規制であって、民間に対する規制ではない。

今回のAI大統領令によって民間に課せられる規制は比較的制限的といえ、従前のように個別法で対応していくという方針は大きくは変わっていない。また、今後のガイダンス等の作成に委ねられているという点で今後も一定の攻防が予想され、規制動向は流動的である。来秋には米大統領選が控えており、そこで政権が変われば、方針が大幅に転換するということもありうる。今後の動きを引き続き注視していき、適宜ご報告していきたい。

参照リンク等

※1 原文はこちら

Executive Order on the Safe, Secure, and Trustworthy Development and Use of Artificial Intelligence | The White House

※2 原文はこちら

Blueprint for an AI Bill of Rights: Making Automated Systems Work for the American People | The White House

※3 原文はこちら

Artificial Intelligence Risk Management Framework (AI RMF 1.0)

※4 原文はこちら

Proposed Memorandum for the Heads of Executive Departments and Agencies

※5 「安全性に影響するAI(safety-impacting AI)」とは、人間の生命・福祉、気候・環境、重要インフラ、戦略的資産・資源の安全性に重大な影響を与�える可能性のあるAIをいう。

※6 「権利に影響するAI(right-impacting AI)」とは、個人又は地域社会の、権利・自由、機会均等、重要な資源やサービスへのアクセスに対して、法律上重大な、または同程度に顕著な影響を及ぼす意思決定又は行動の基礎となるAIをいう。